Attention and Memory in Deep Learning (Alex Graves, DeepMind x UCL DL Lecture 8)

19 May 2022세계 최고의 머신 러닝 학회인 NIPS 에 Attention is All you Need 라는 이름으로 Transformer Network Architecture가 공개된 지 5년이란 시간이 흘렀습니다. 이제는 NLP부터 CV 까지 안 쓰이는 곳이 없는 General Purpose Network 가 되었는데요, 본 post에서는 Deepmind의 Research Scientist 인 Alex Graves 가 Transformer 의 핵심 요소인 Attention 에 대한 본인의 직관을 담은 영상을 리뷰해보려고 합니다.

< 목차 >

Overview

Fig. Slide 4.

Fig. Slide 4.

말씀드린 것 처럼 주제는 Attention 과 딥러닝 입니다.

내용을

Fig. Slide 3.

Fig. Slide 3.

요약

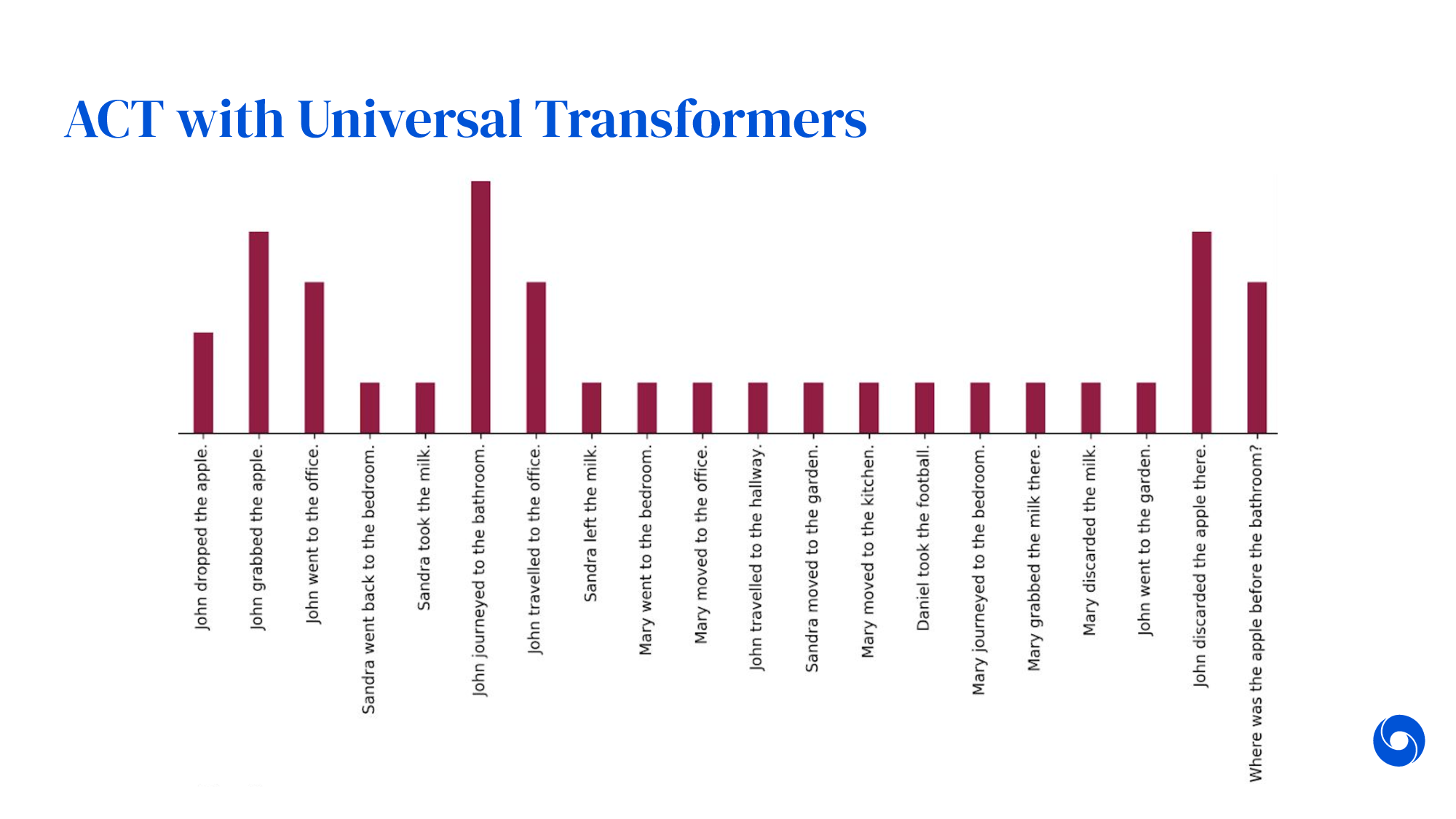

Fig. Slide 67.

Fig. Slide 67.

Introduction

tmp

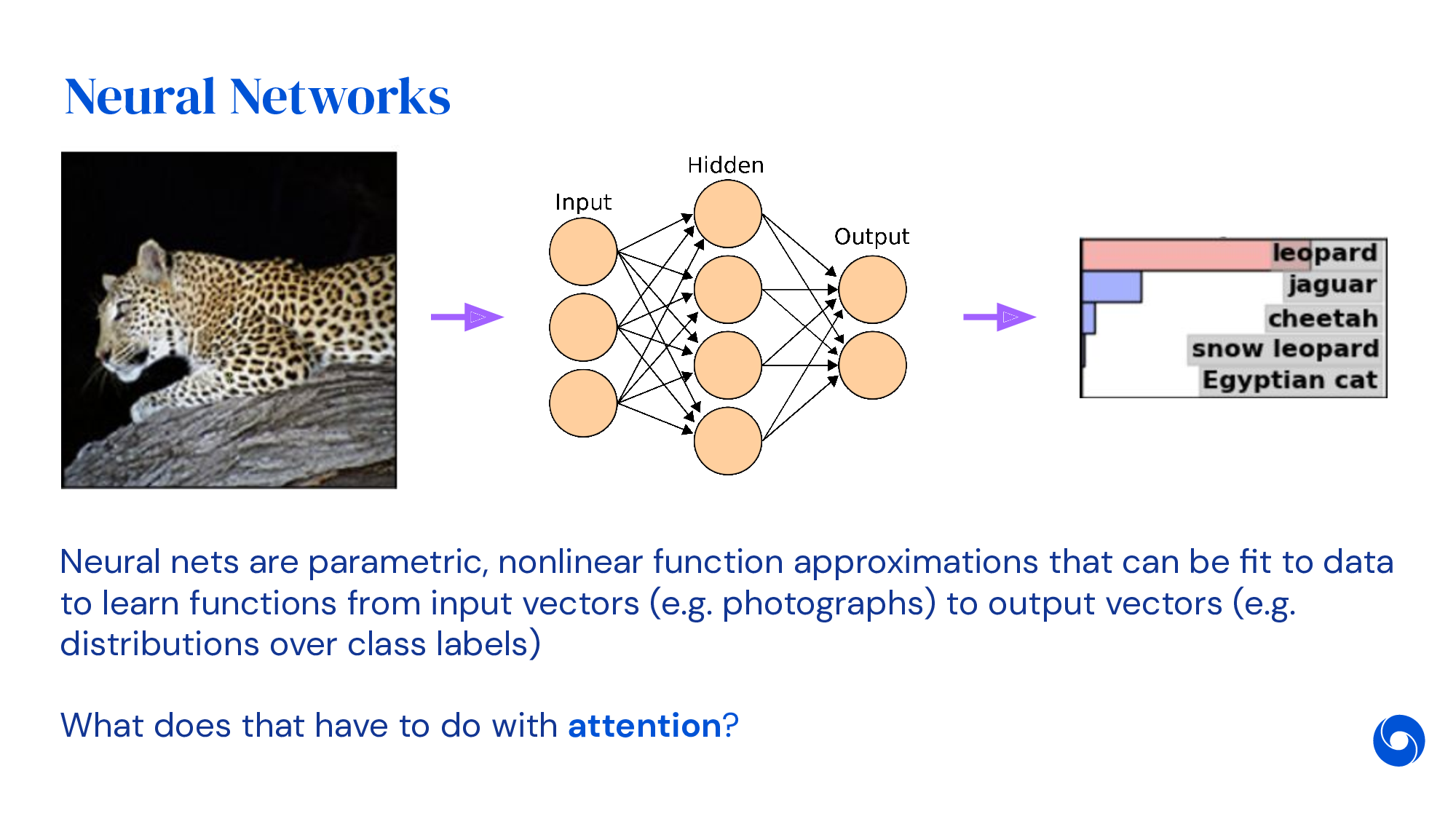

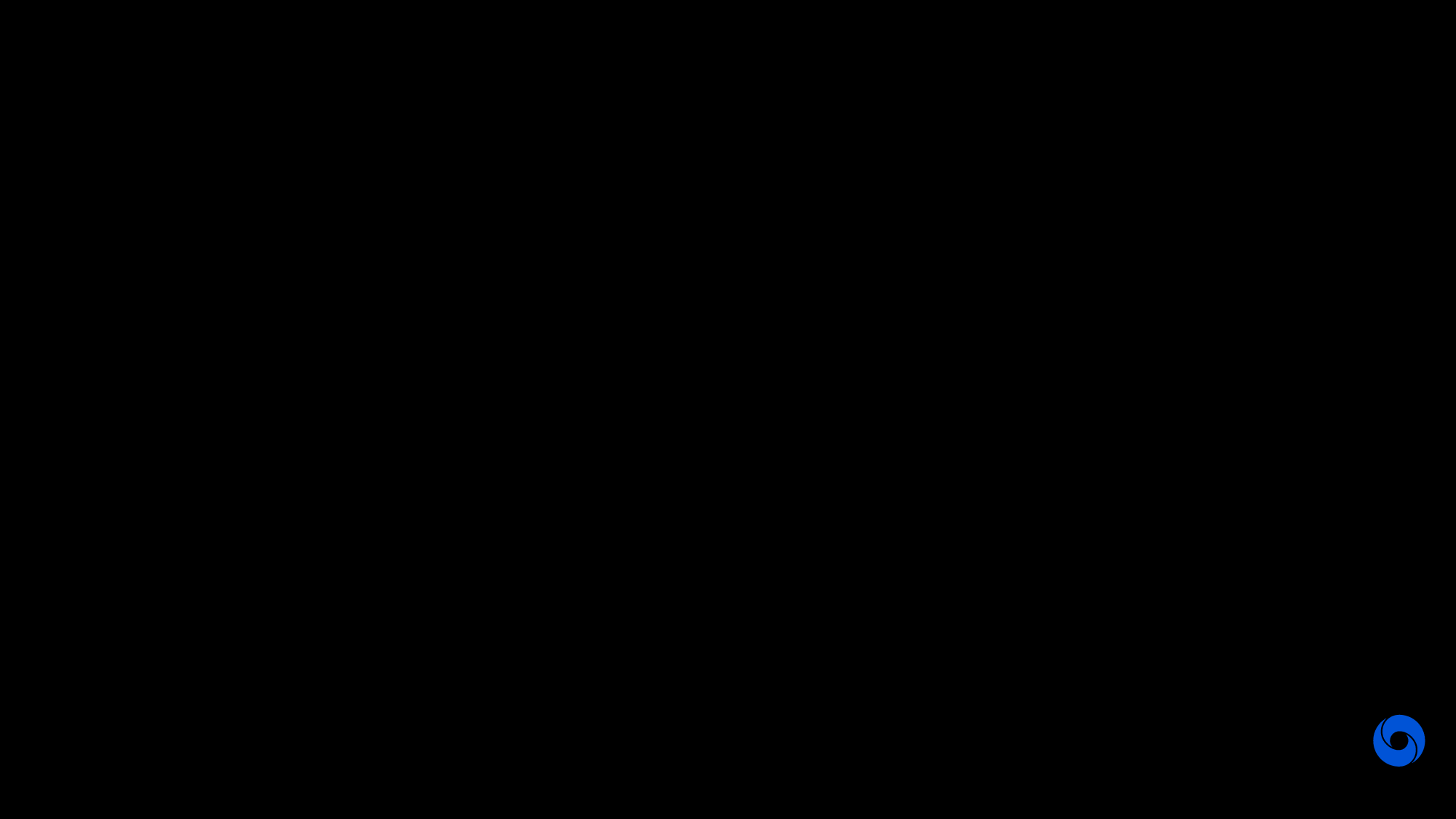

Fig. Slide 5.

Fig. Slide 5.

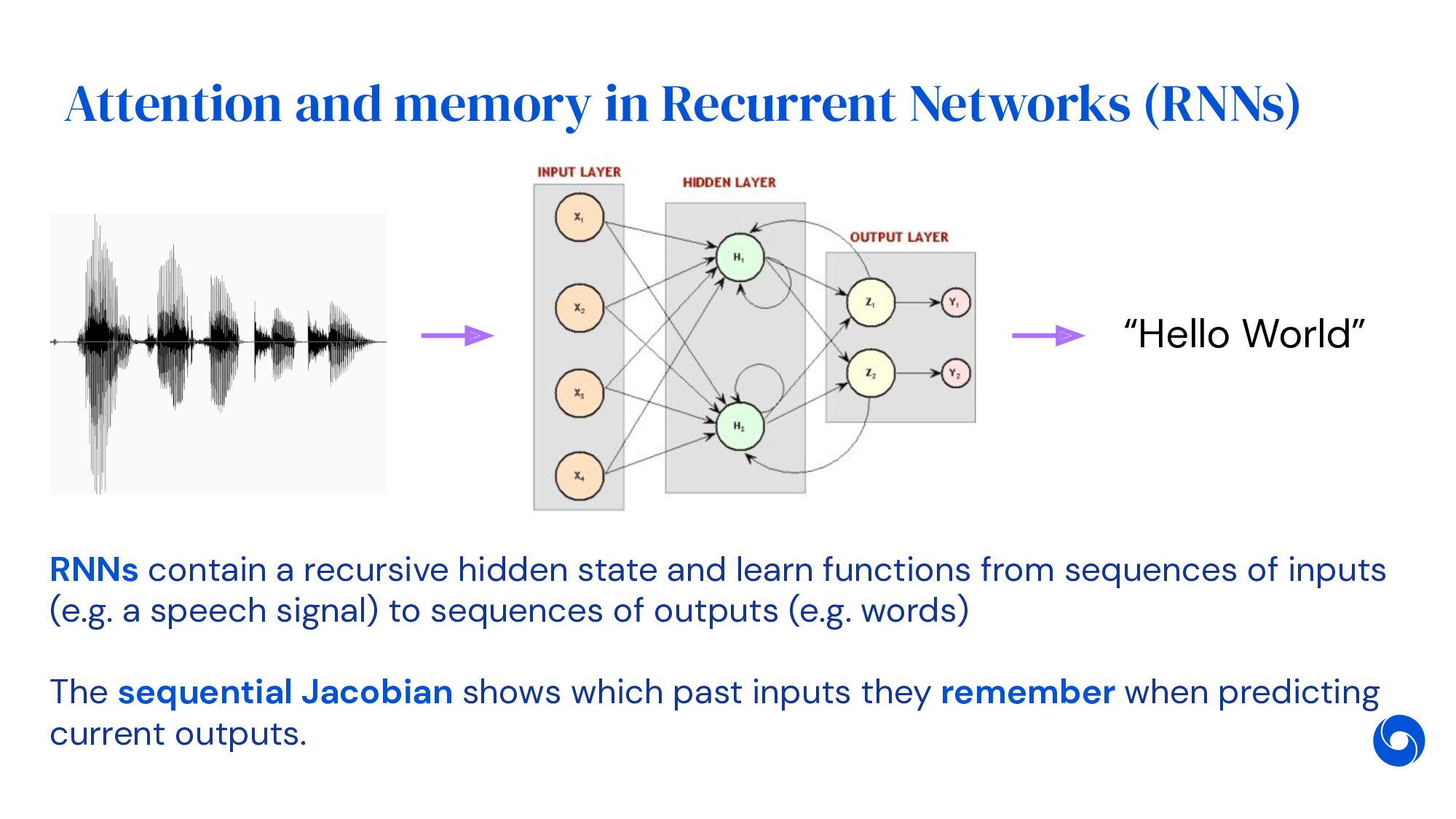

Fig. Slide 6.

Fig. Slide 6.

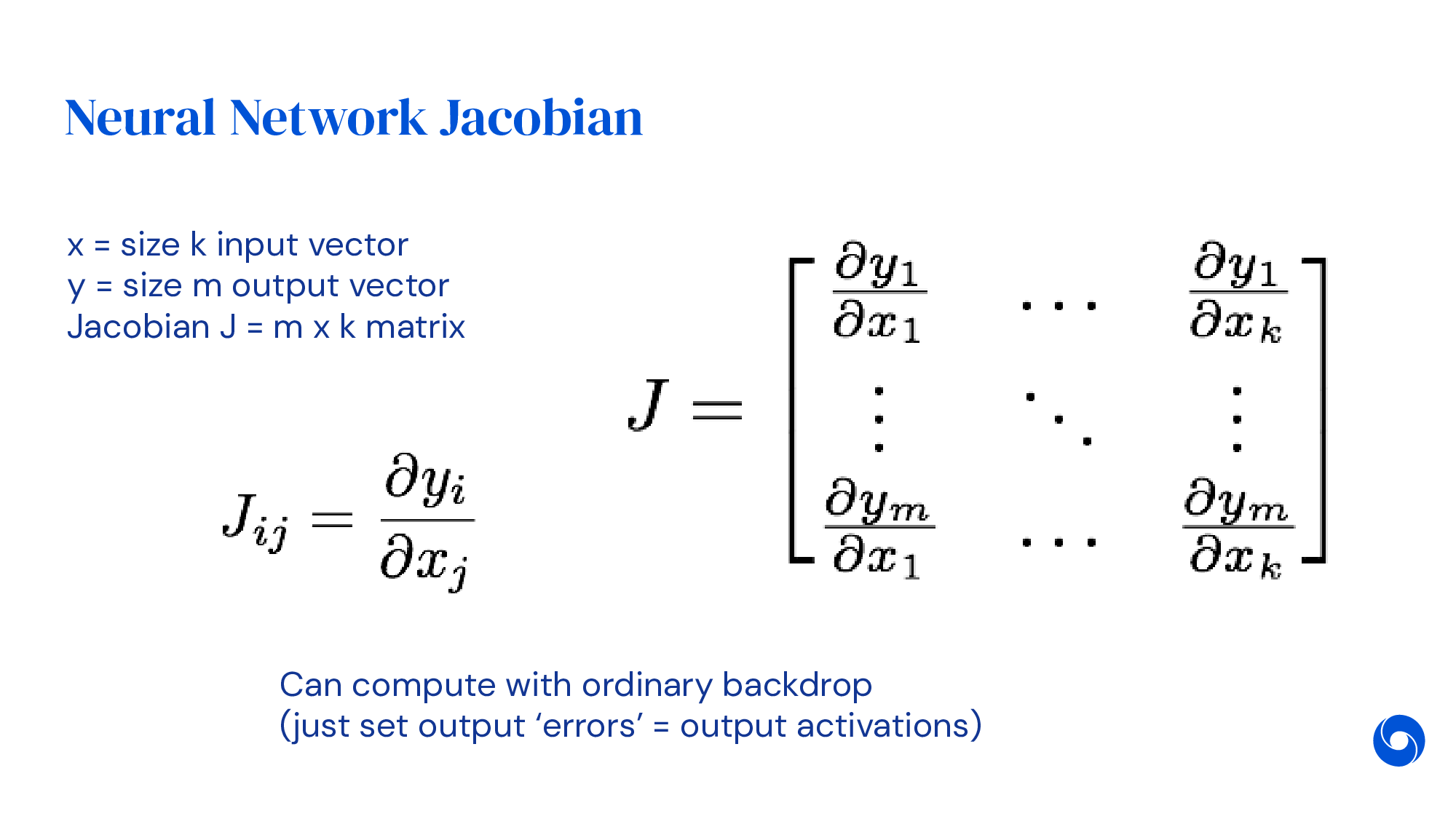

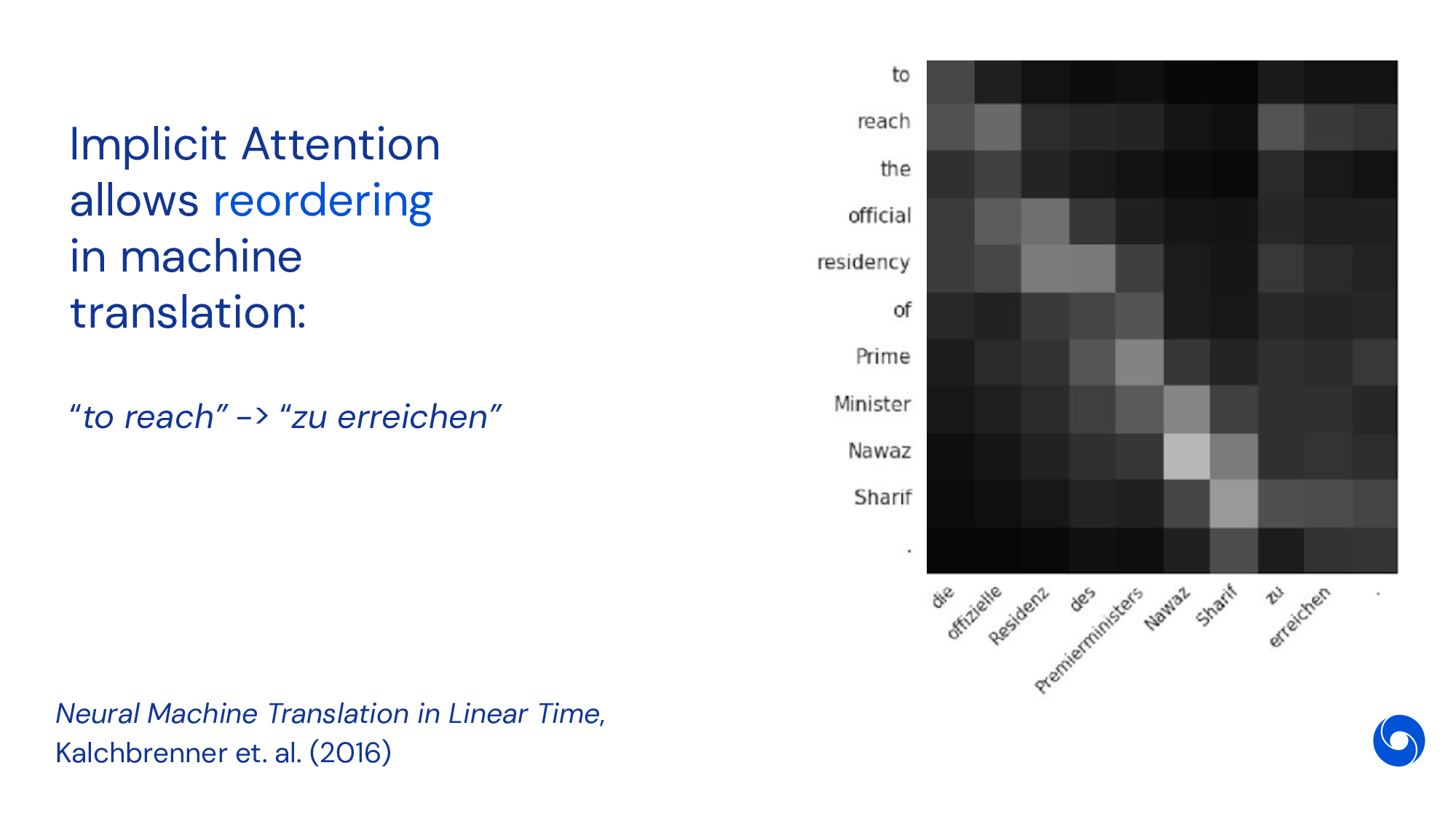

Fig. Slide 7.

Fig. Slide 7.

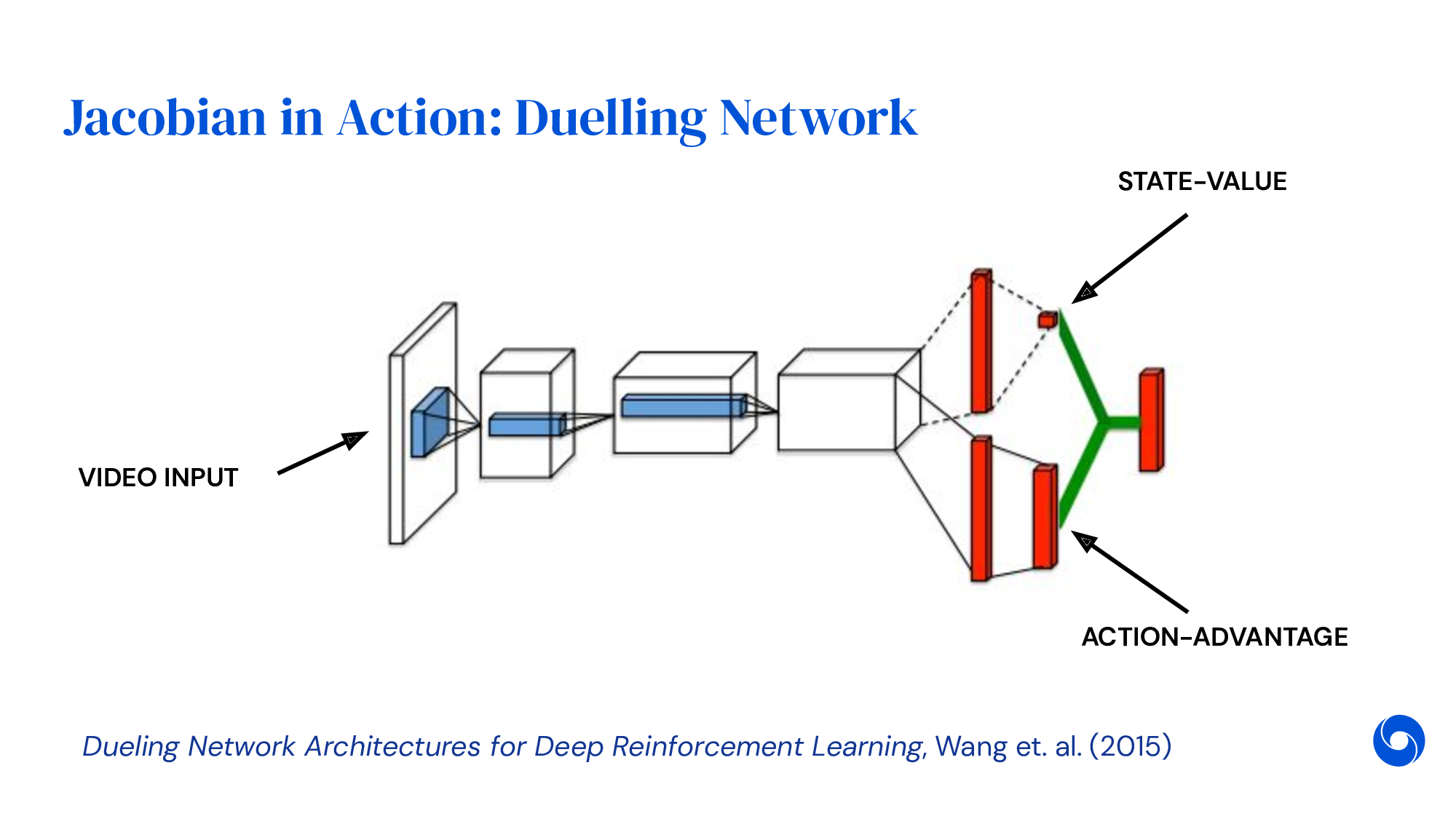

Fig. Slide 8.

Fig. Slide 8.

Fig. Slide 9.

Fig. Slide 9.

Fig. Slide 10.

Fig. Slide 10.

Fig. Slide 11.

Fig. Slide 11.

Fig. Slide 12.

Fig. Slide 12.

Fig. Slide 13.

Fig. Slide 13.

Fig. Slide 14.

Fig. Slide 14.

Fig. Slide 15.

Fig. Slide 15.

Fig. Slide 16.

Fig. Slide 16.

Fig. Slide 17.

Fig. Slide 17.

Fig. Slide 18.

Fig. Slide 18.

Fig. Slide 19.

Fig. Slide 19.

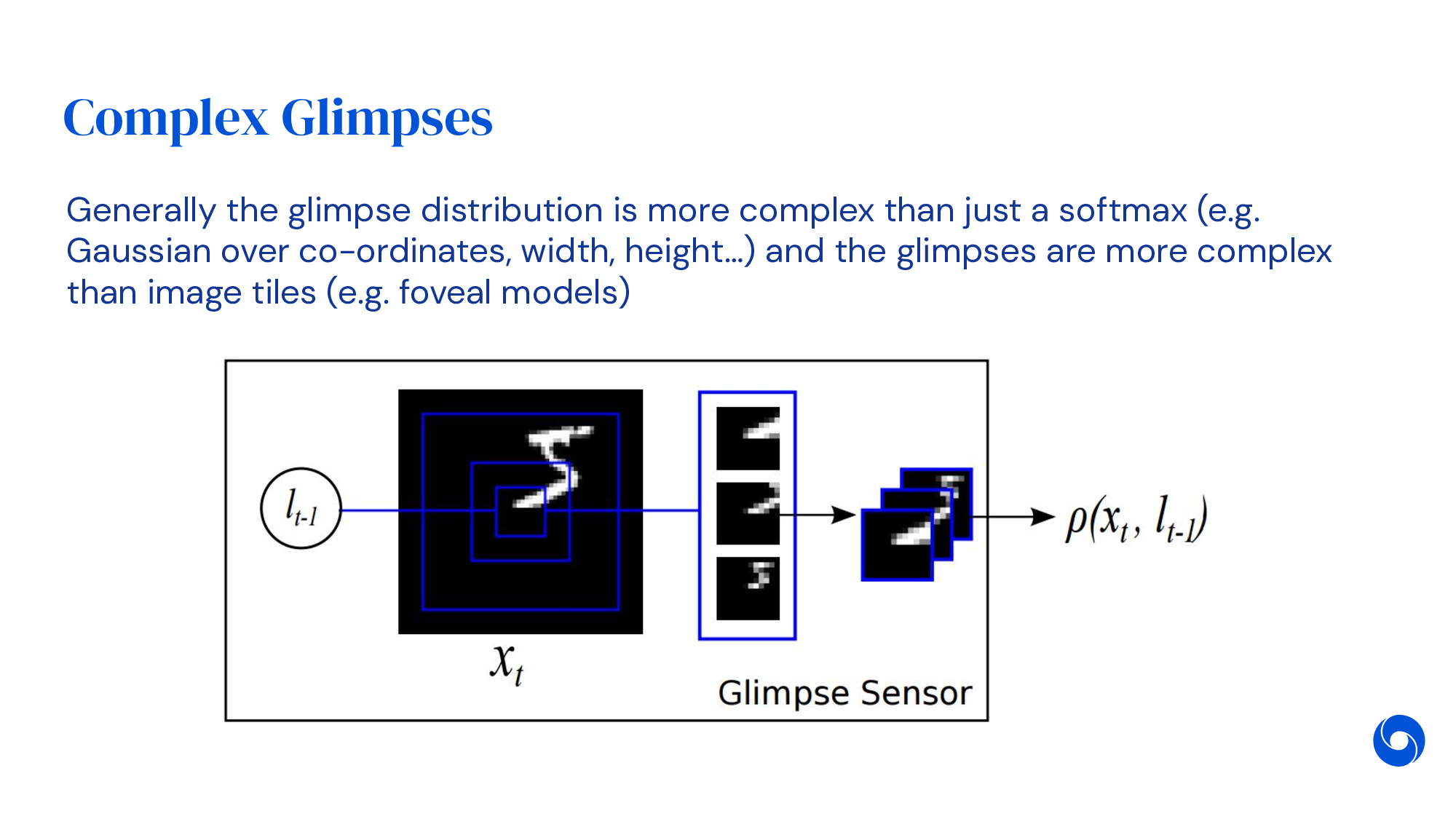

Fig. Slide 20.

Fig. Slide 20.

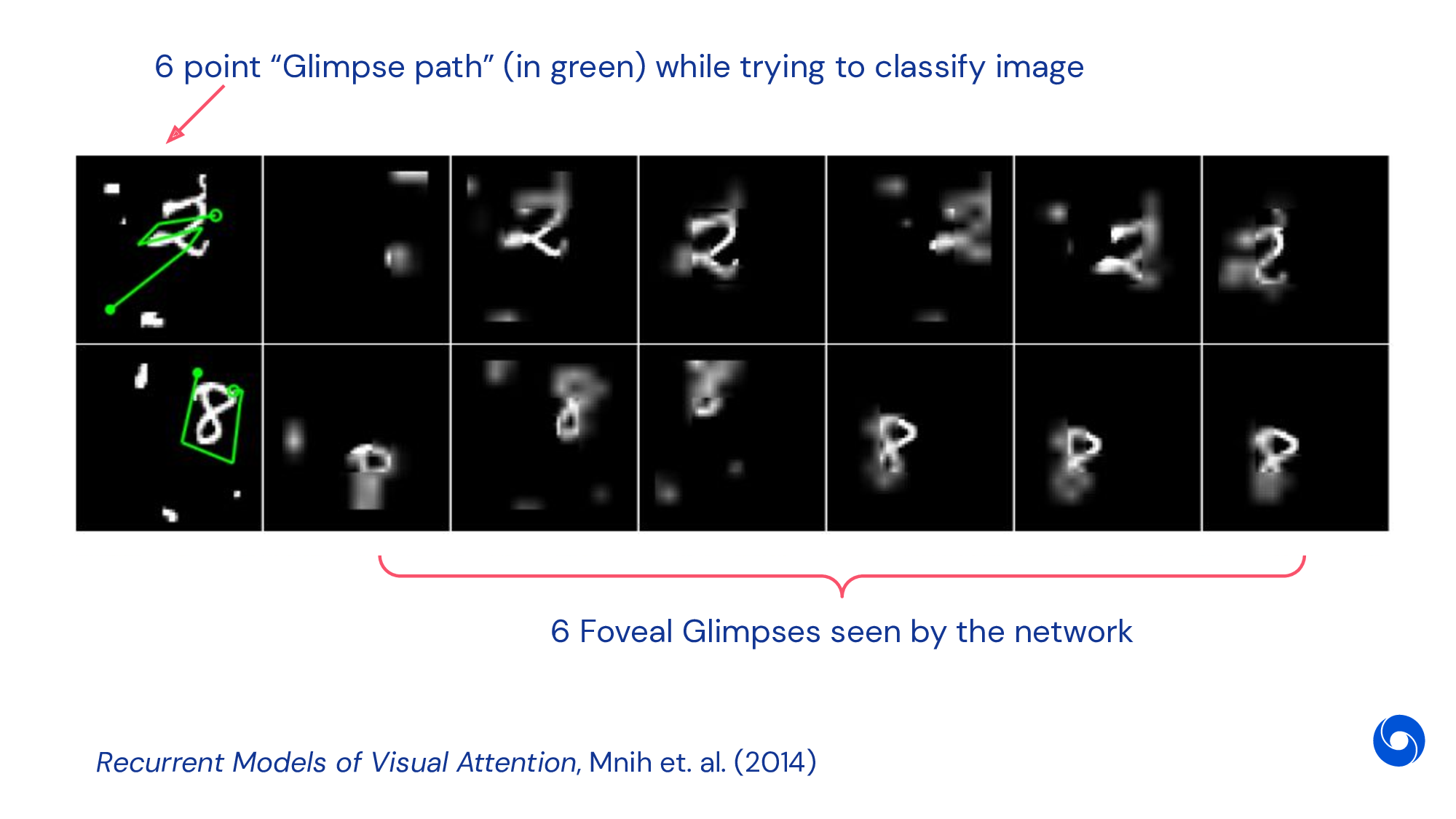

Fig. Slide 21.

Fig. Slide 21.

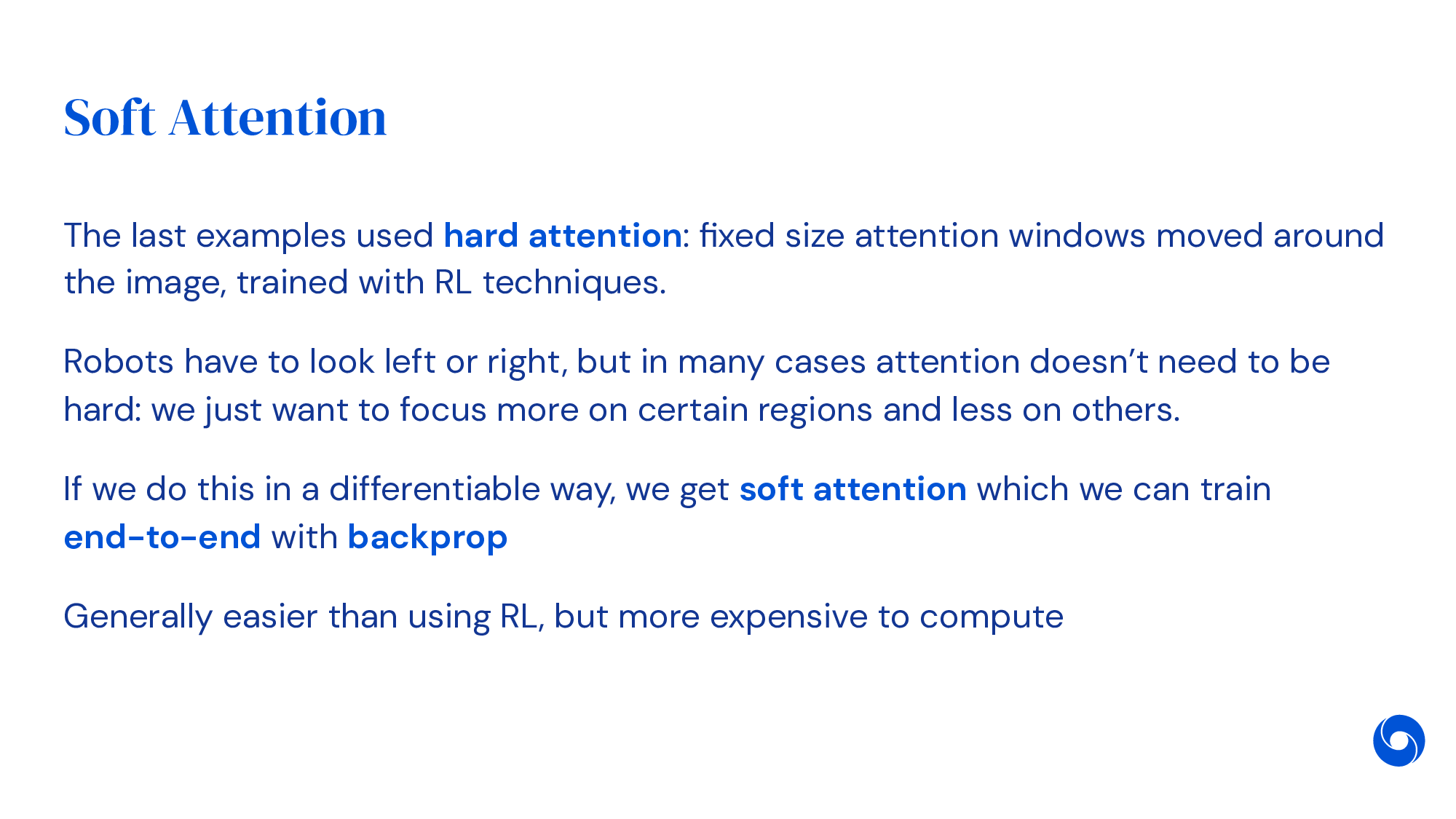

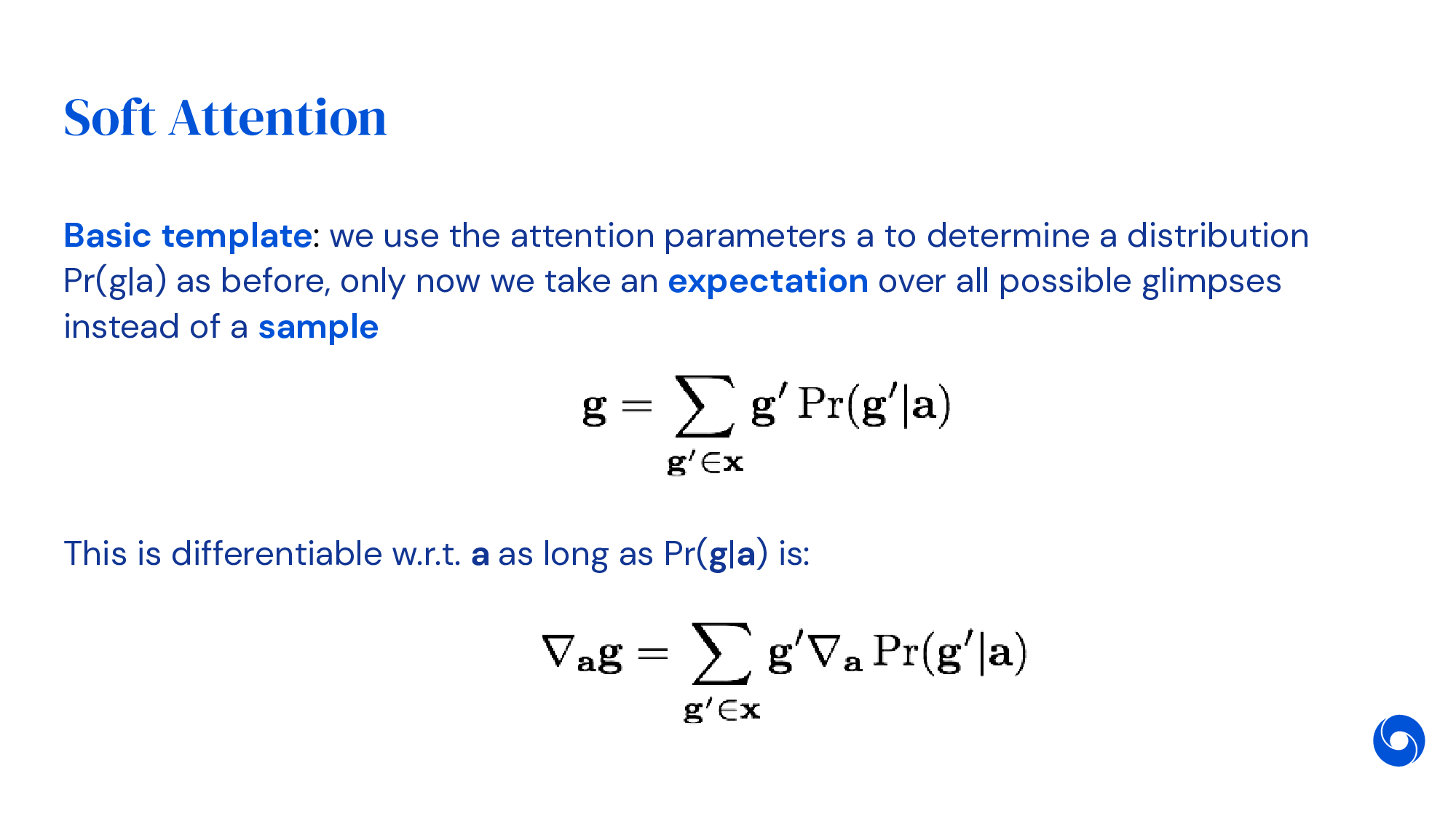

Soft Attention

Fig. Slide 22.

Fig. Slide 22.

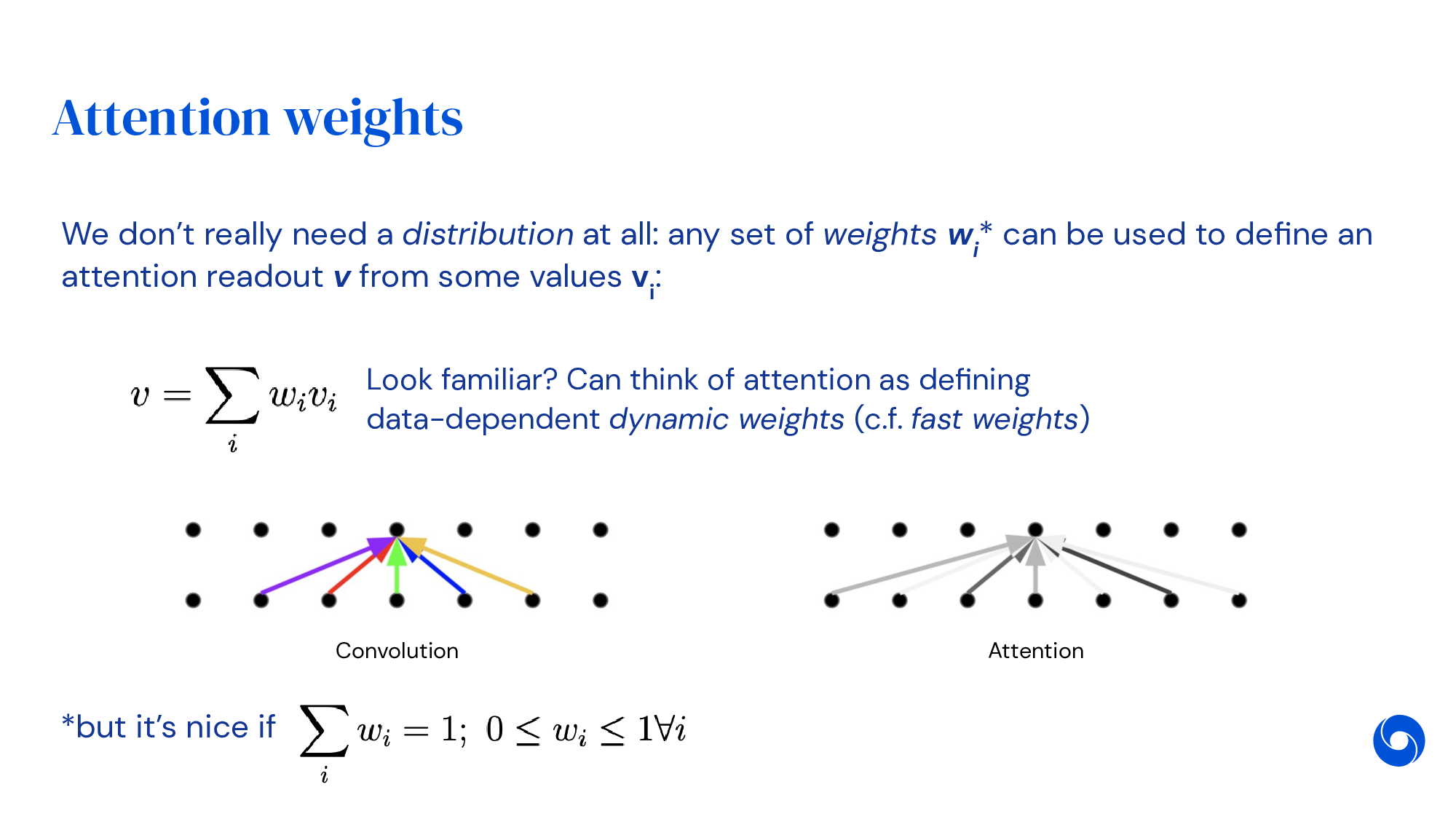

Fig. Slide 23.

Fig. Slide 23.

Fig. Slide 24.

Fig. Slide 24.

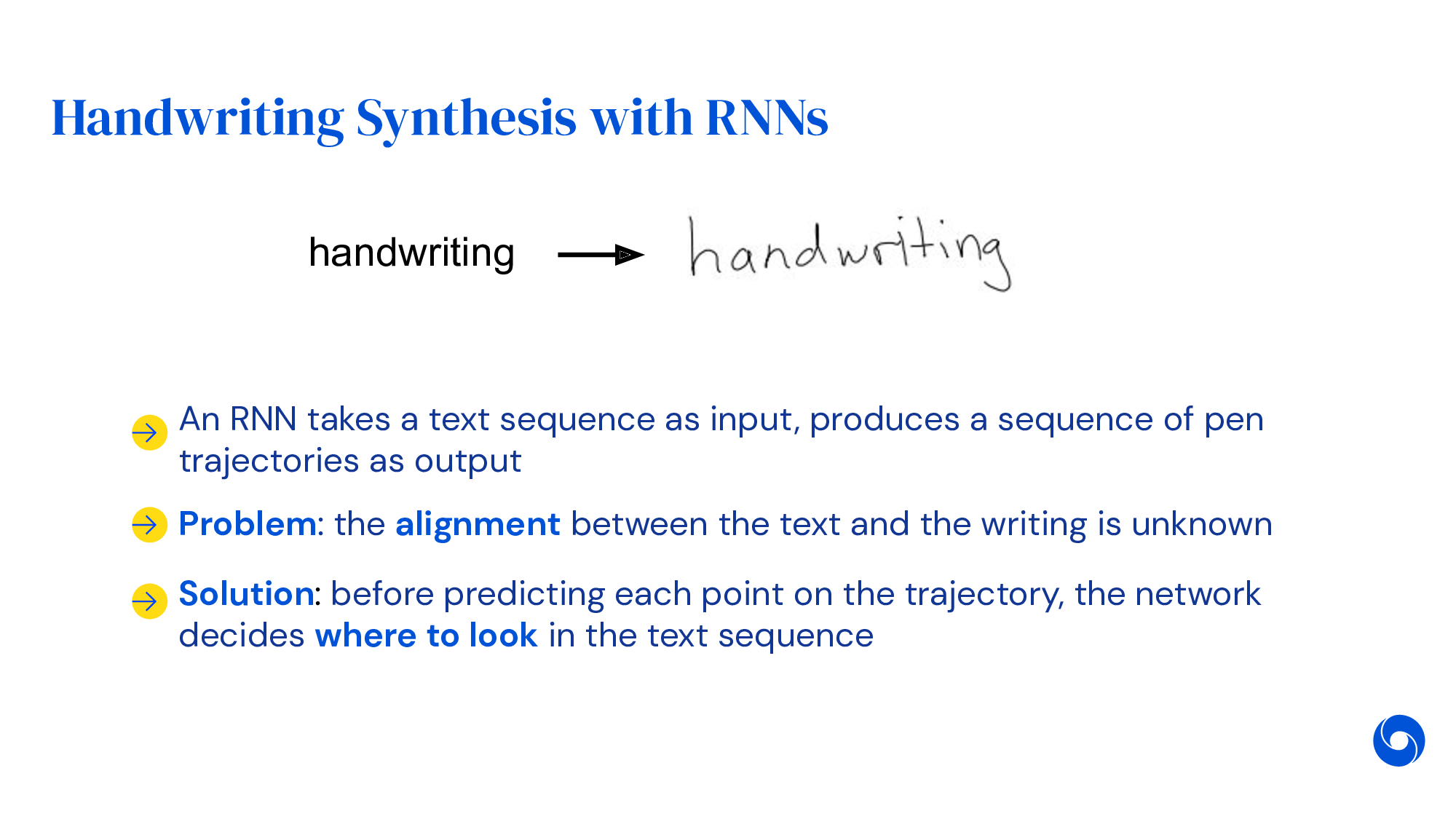

Fig. Slide 25.

Fig. Slide 25.

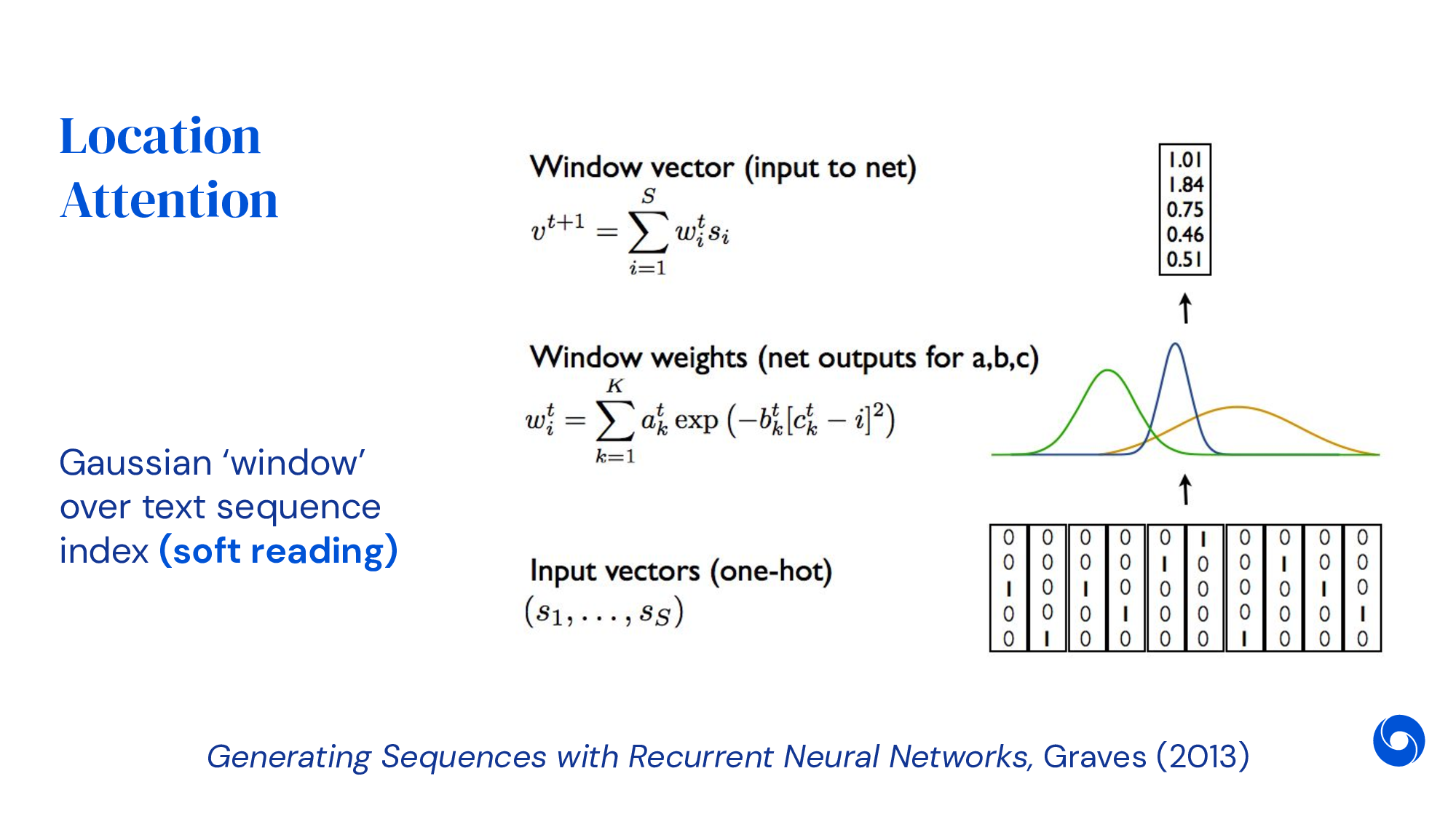

Fig. Slide 26.

Fig. Slide 26.

Fig. Slide 27.

Fig. Slide 27.

Fig. Slide 28.

Fig. Slide 28.

Fig. Slide 29.

Fig. Slide 29.

Fig. Slide 30.

Fig. Slide 30.

Fig. Slide 31.

Fig. Slide 31.

Fig. Slide 32.

Fig. Slide 32.

Fig. Slide 33.

Fig. Slide 33.

Fig. Slide 34.

Fig. Slide 34.

Fig. Slide 35.

Fig. Slide 35.

Fig. Slide 36.

Fig. Slide 36.

Fig. Slide 37.

Fig. Slide 37.

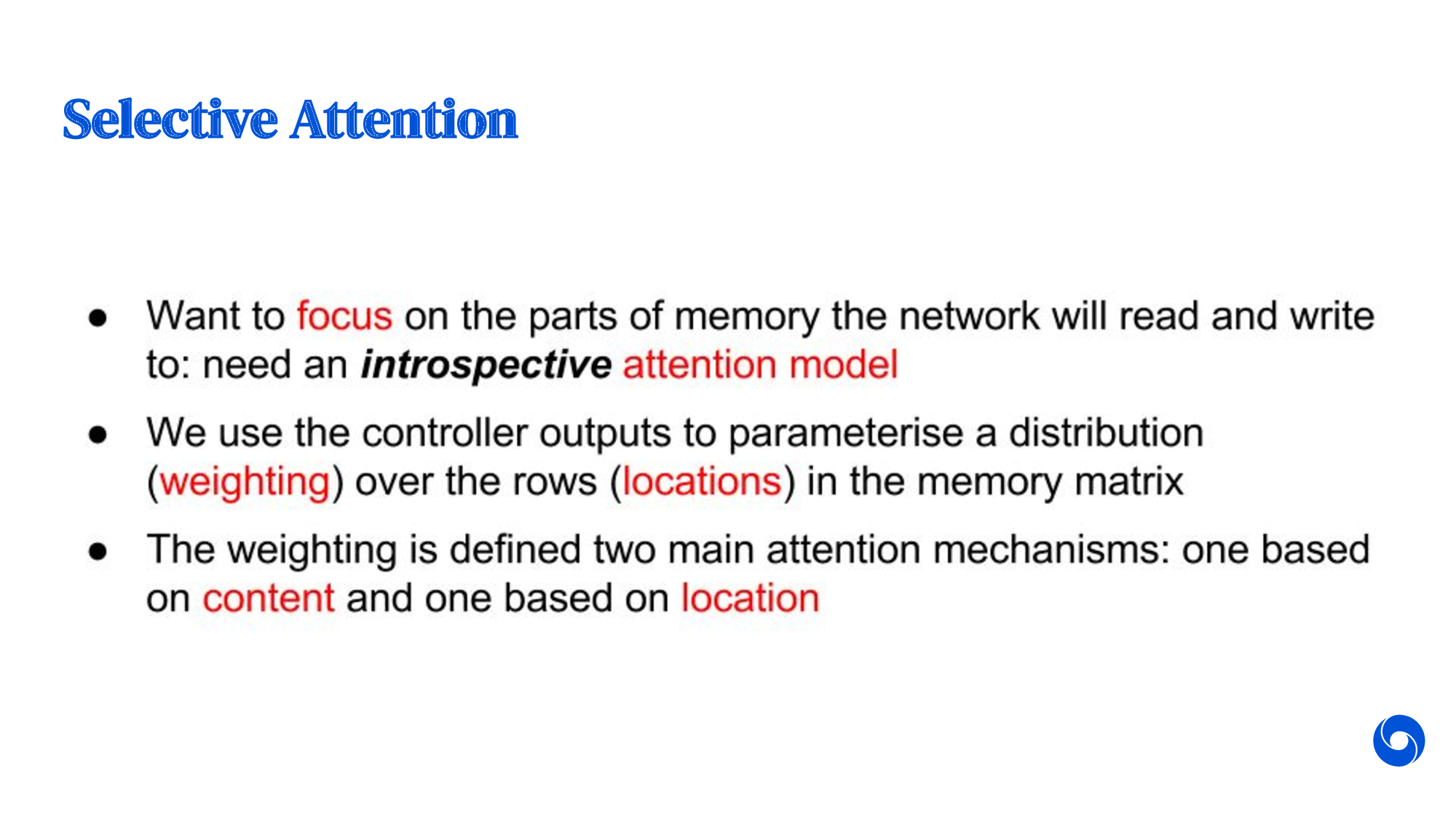

Introspective Attention

Fig. Slide 38.

Fig. Slide 38.

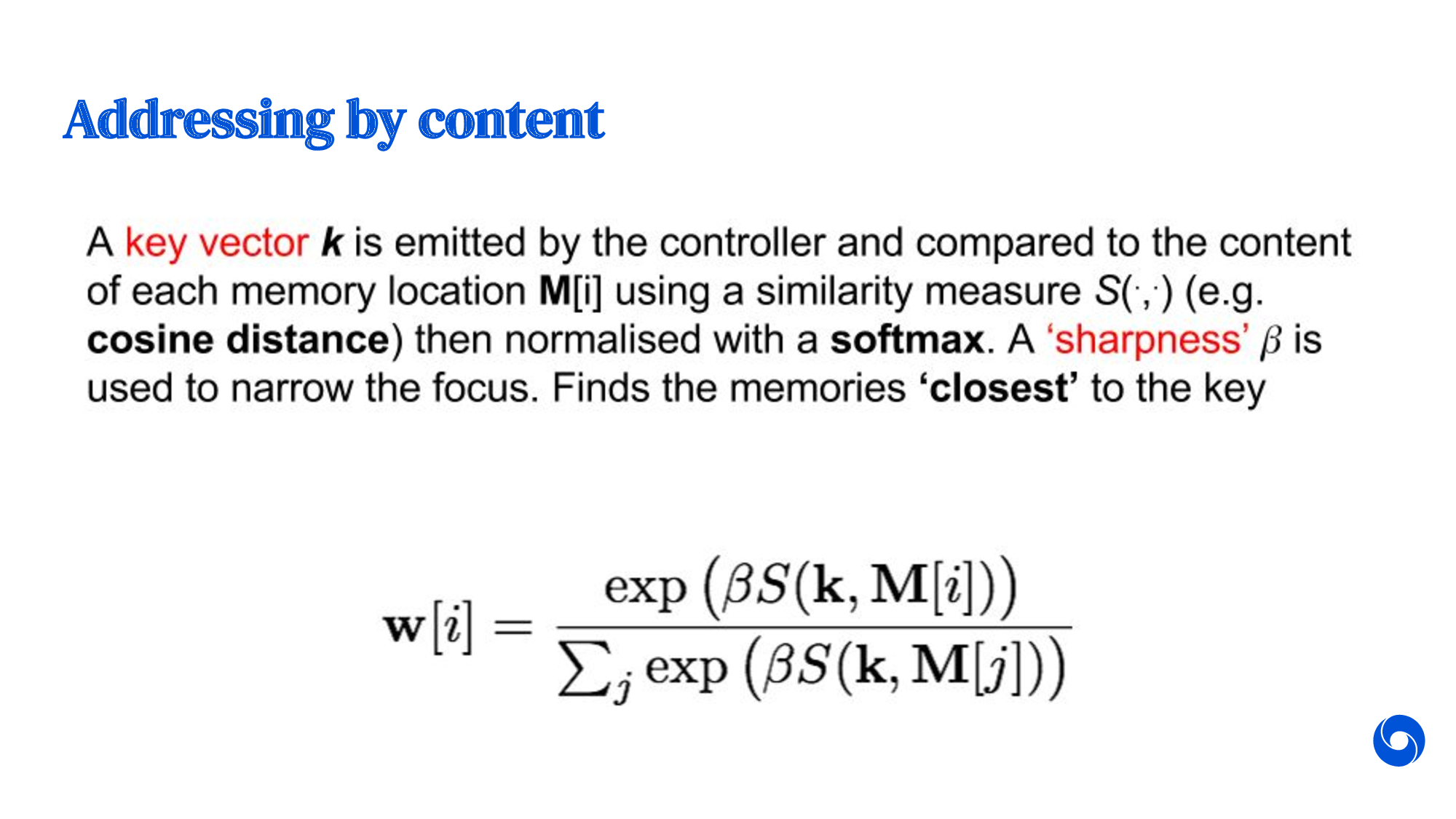

Fig. Slide 39.

Fig. Slide 39.

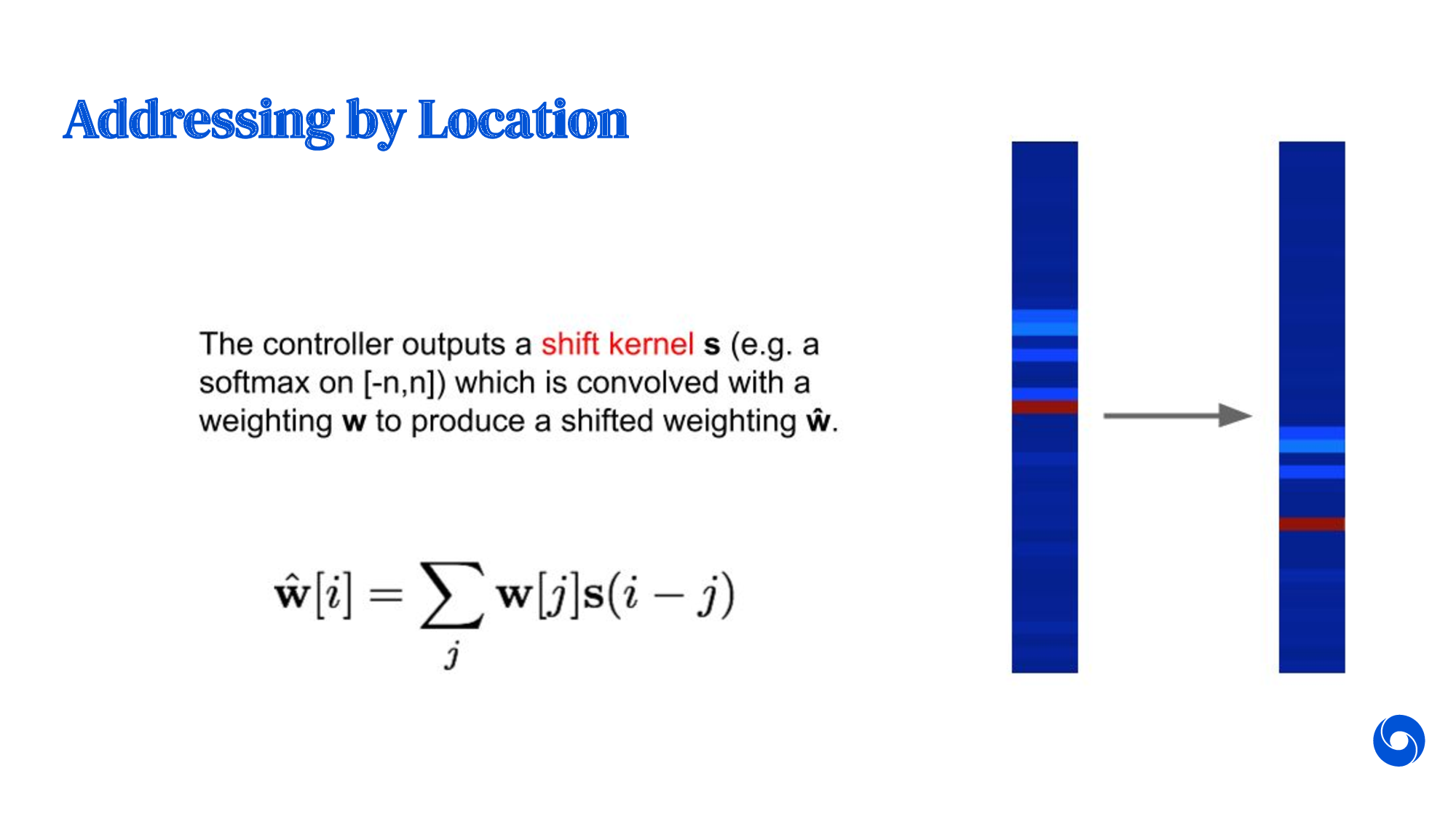

Fig. Slide 40.

Fig. Slide 40.

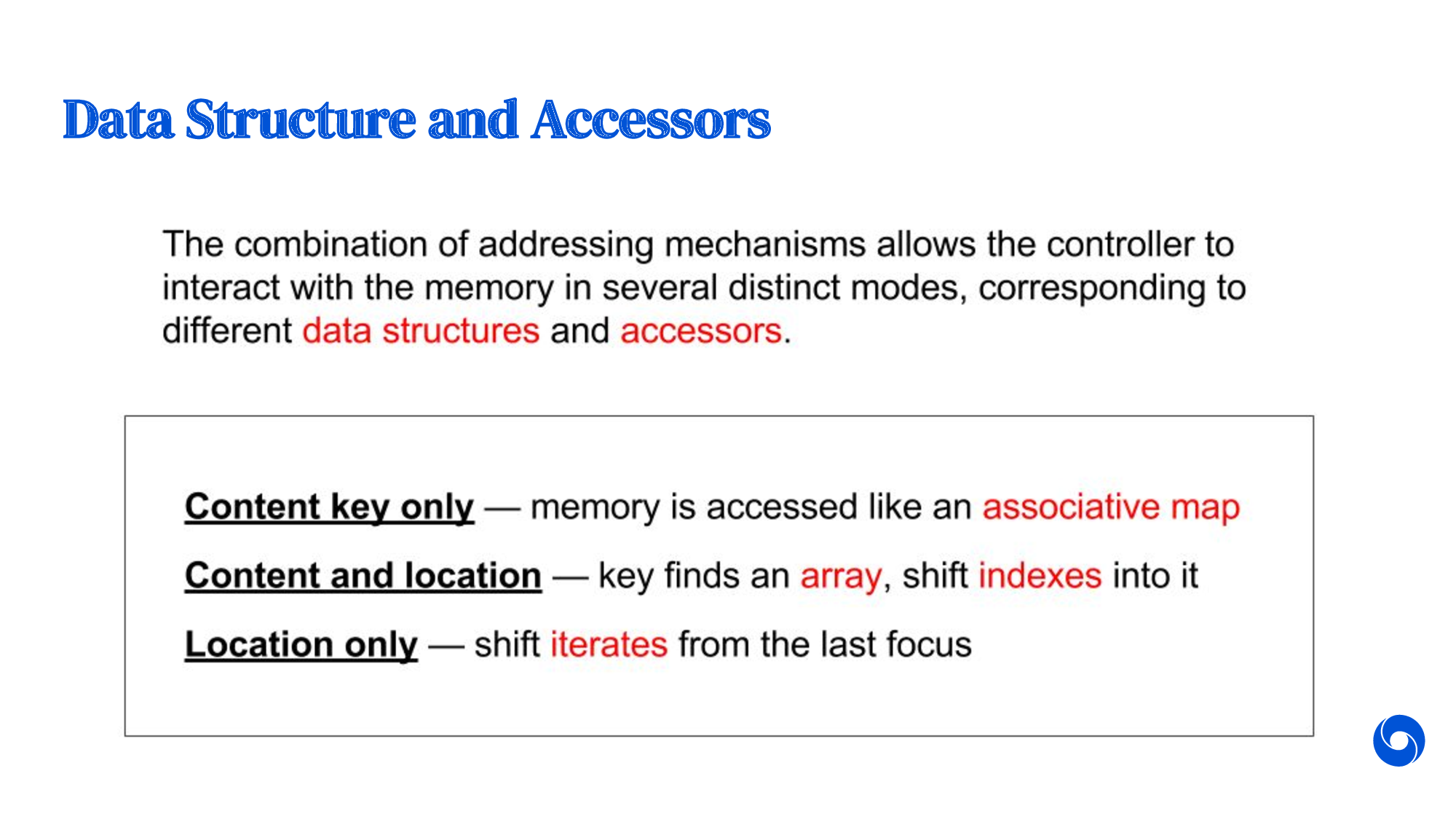

Fig. Slide 41.

Fig. Slide 41.

Fig. Slide 42.

Fig. Slide 42.

Fig. Slide 43.

Fig. Slide 43.

Fig. Slide 44.

Fig. Slide 44.

Fig. Slide 45.

Fig. Slide 45.

Fig. Slide 46.

Fig. Slide 46.

Fig. Slide 47.

Fig. Slide 47.

Fig. Slide 48.

Fig. Slide 48.

Fig. Slide 49.

Fig. Slide 49.

Fig. Slide 50.

Fig. Slide 50.

Fig. Slide 51.

Fig. Slide 51.

Fig. Slide 52.

Fig. Slide 52.

Fig. Slide 53.

Fig. Slide 53.

Fig. Slide 54.

Fig. Slide 54.

Fig. Slide 55.

Fig. Slide 55.

Further Topics

Fig. Slide 56.

Fig. Slide 56.

Fig. Slide 57.

Fig. Slide 57.

Fig. Slide 58.

Fig. Slide 58.

Fig. Slide 59.

Fig. Slide 59.

Fig. Slide 60.

Fig. Slide 60.

Fig. Slide 61.

Fig. Slide 61.

Fig. Slide 62.

Fig. Slide 62.

Fig. Slide 63.

Fig. Slide 63.

Fig. Slide 64.

Fig. Slide 64.

Fig. Slide 65.

Fig. Slide 65.

Fig. Slide 66.

Fig. Slide 66.

Fig. Slide 67.

Fig. Slide 67.